|

|

||||||||||

|

||||||||||

|

Matemáticas para los

estudiantes de humanidades

Morris Kline

FCE, México, 2009.

|

||||||||||

|

Durante milenios, las matemáticas han sido el ejemplo por

excelencia de las verdades descubiertas por el hombre. De ahí que todas las investigaciones relativas al problema de adquirir verdades hayan tenido que ver, necesariamente, con las matemáticas. Aunque algunos de los pasmosos avances realizados en el siglo xix alteraron por completo nuestra idea de la naturaleza de las matemáticas, la eficacia de éstas, especialmente para representar y analizar fenómenos naturales, las ha mantenido en el foco de todas las investigaciones de la naturaleza del conocimiento. Uno de los aspectos, y no el menos importante de este valor de las matemáticas, es que nos ha permitido ver en acción las facultades de la mente humana. Las matemáticas constituyen el ejemplo supremo y más notable del poder de la mente para encarar problemas, y como tal, vale la pena estudiarlas.

Entre los valores que las matemáticas ofrecen están los servicios prestados a las artes. La mayoría de la gente se inclina a pensar que las artes son independientes de las matemáticas, pero pronto veremos que éstas han contribuido a dar forma a muchos de los estilos sobresalientes de pintura y arquitectura, y el servicio que las matemáticas prestan a la música no sólo nos ha hecho posible entenderla, sino que ha propagado su disfrute por los cuatro puntos cardinales.

Problemas prácticos, científicos, filosóficos y artísticos han impulsado a los hombres a investigar en el terreno de las matemáticas. Pero hay otro motivo más fuerte que los anteriores: la búsqueda de la belleza. Las matemáticas son un arte. Esto significa que ofrecen los mismos placeres que cualquiera de las ramas artísticas. Esta afirmación acaso moleste a quienes están acostumbrados al concepto tradicional de las artes verdaderas; mentalmente contrastarán con otras en detrimento de las matemáticas. Pero el individuo común y corriente no se ha detenido a pensar en lo que realmente son las artes y qué ofrecen. Lo que la mayoría de la gente ve en la pintura, por ejemplo, son escenas familiares y acaso colores atractivos. Pero estas cualidades no son las que hacen de la pintura un arte. Sus valores reales deben aprenderse, y la genuina apreciación del arte demanda mucho estudio.

No insistiremos, con todo, en los valores estéticos de las matemáticas. Será más fácil sostenernos en la posición de que así como hay personas sin oído para la música y ciegas al color, así también hay las del temperamento que no tolera la argumentación fría ni las distinciones, al parecer sutiles en demasía, que se hacen en la empresa matemática.

Nos gustaría entender qué son las matemáticas, qué hacen, qué le dan al mundo y qué es lo que ofrecen en sí mismas. Esperamos ver qué contienen las matemáticas que auxilian al físico y al sociólogo, al filósofo, al lógico, al artista: qué es lo que influye en las doctrinas del estadista y del teólogo; qué es lo que satisface la curiosidad del hombre que explora los cielos y la del que reflexiona en la dulzura de los sonidos musicales, y qué lo que ha influido innegablemente, aunque a veces imperceptiblemente en el curso de la historia moderna. Trataremos de ver, en fin, que las matemáticas son parte inseparable del mundo moderno, una de las fuerzas que modelan los pensamientos y los actos humanos y un todo del pensamiento vivo conectado indisolublemente con todas las demás ramas de la cultura, de las cuales depende y a las que otorga valiosos dones.

|

||||||||||

|

_____________________________________________________________

|

||||||||||

|

Fragmento de la Introducción.

como citar este artículo → Kline, Morris. (2011). Matemáticas para los estudiantes de humanidades. Ciencias 102, abril-junio, 78. [En línea]

|

||||||||||

|

|

PDF →

|

|||||||||

|

||||||||||

|

“O inventamos o erramos”

La ciencia como idea-fuerza en América Latina

Hebe Vessuri

Universidad Nacional de Quilmes, Editorial Bernal, 2007.

|

||||||||||

|

El surgimiento de los estudios sociales de la ciencia en

América Latina coincidió y de alguna forma constituyó una respuesta a la emergencia de una cultura mundial, globalizada, con características sui generis, y que incide de manera muy directa sobre la comunicación y la producción científicosocial de nuestros países. Por un lado, la homogeneización cultural creciente que acompaña al proceso de globalización viene produciendo una simplificación de nuestras realidades con la consiguiente pérdida cultural. Asimismo, se favorece un recurso a pequeñas unidades sociales, desprovistas de consideraciones contextuales, en una tendencia a analizar las especificidades individuales y de mínima escala de agregación de las relaciones sociales, que también hace perder de vista las unidades de significación intermedia, como países, estados, etnias, clases y estamentos. Frente a este proceso, los estudios sociales de la ciencia en la región introdujeron un componente de exploración y visibilización de la incorporación activa de las sociedades latinoamericanas a los procesos de internacionalización del campo científico.

Ya no se trata simplemente de ver el proceso de difusión de la ciencia europea al resto del mundo, sino de la apropiación del saber científico y su institucionalidad por parte de los grupos científicos y sociedades latinoamericanos, la valorización de la actividad local y la importancia de los procesos por los cuales fue construyendo (y a veces destruyendo) el sentido de la identidad nacional, étnica o colectiva en nuestras sociedades.

Los estudios sociales de la ciencia en América Latina podrían ser vistos como parte de los esfuerzos por asegurar la comunicación intercultural, con una mayor conciencia de los determinantes y especificidades culturales de los diferentes ámbitos nacionales y lingüísticos por parte de la investigación social. A lo largo de los últimos treinta años han aparecido nuevos temas, nuevas narrativas, nuevos interlocutores. Las posibilidades de investigaciones novedosas y útiles se han multiplicado, así como también la de otras tantas agendas para la investigación social.

Algunos temas siempre me han motivado. Así, hablaré brevemente de tres de ellos, con la idea de establecer un nexo con los trabajos que siguen. En primer lugar me referiré a la narrativa, la memoria y la crítica. Un segundo tema que nos ocupa en este libro es el de la relación de los científicos con la sociedad, y fundamentalmente con su cultura y valores. Finalmente, un eje problemático que como investigadora en una región del mundo en desarrollo ha marcado mi aproximación al conocimiento como desafío, ideafuerza y aspiración para nuestras sociedades es el tema del desarrollo.

En el mundo contemporáneo las cuestiones ligadas al conocimiento se mueven en un frente amplio, que va desde los discursos especializados de la política científica y la educación superior, hasta el escenario de la moderna política de la globalización y la competitividad. Siendo, como se predica, el conocimiento un aspecto definitorio clave del mundo actual y futuro, no puede sorprender a nadie que se vuelva una noción cada vez más políticamente cargada, en la cual una gama de intereses diversos pretenden prevalecer.

Tanto en países desarrollados como en aquellos en desarrollo, los gobiernos parecen haberse dado cuenta de que el compromiso de la ciudadanía es vital para asegurar que la ciencia y la tecnología satisfagan las necesidades de la gente. Somos testigos de intereses e inversiones internacionales sin precedentes que vinculan la ciencia y la tecnología con el desarrollo.

Especialmente desde la década pasada viene dándose un debate cada vez más tenso y divisivo, si bien rico y creativo, acerca de las condiciones de producción, diseminación y absorción del conocimiento en sociedades particulares. Entre los resultados que se fueron decantando de ese diálogo, a veces de sordos, está el reconocimiento de que ya no basta con dejar estas cuestiones simplemente a la comunidad académica. El fuero académico se percibe cada vez más como una entre otras fuentes de interés relacionadas con el conocimiento, en circunstancias en que estas cuestiones adquieren creciente significación para grupos más grandes y heterogéneos.

“O inventamos o erramos”, insistía hace ya casi dos siglos Simón Rodríguez, ese ejemplar educador venezolano, quien tuvo una vida dura y comprometida con la realidad de un tiempo o región. La historia se ha encargado de confirmar múltiples veces que los enfoques educativos impuestos desde arriba no funcionan. Las soluciones educativas renovadoras se basan en el ensayo y el error, con un ciclo de retroalimentación basado en la experiencia misma. En la aventura del conocimiento en general y de la ciencia en particular también rinde el experimentar, el atreverse a recorrer caminos que van más allá de las modas aceptadas como verdades reveladas. La inquietud que ha movido los intereses reunidos en este libro, inspirados en el desafío de Rodríguez, es desentrañar las raíces de nuestra subordinación melancólica como periferia de la historia y el presente, con énfasis en las oportunidades y virtudes de hacer camino al andar, abriendo trochas, reuniendo los pedazos de nuestra identidad fragmentada. La ciencia ha sido una ideafuerza en la región latinoamericana que en algunos momentos logró aglutinar voluntades, pero siempre fue insuficiente y casi nunca logró cuajar en un aparato científico con dinámica propia. El poder político y económico en la región ha usado la ciencia en el discurso retórico pero raramente como instrumento de desarrollo social, cultural y económico. El potencial, sin embargo, está allí, la “cátedra sumergida” puede aflorar un día en todo sus esplendor. ¿El siglo xxi podría ser el siglo de la ciencia para América Latina?

como citar este artículo → Vessuri, Hebe. (2011). "O inventamos o erramos". La ciencia como idea-fuerza en América Latina. Ciencias 102, abril-junio, 58-59. [En línea]

|

||||||||||

|

|

PDF →

|

||||||||||

|

|||||||||||

|

Modelo de convergencia

de opiniones

Yérali Gandica, Marcelo del Castillo

Mussot, Sergio Rojas y Gerardo J. Vázquez

|

|||||||||||

|

En el estudio de la dinámica social, la capacidad de una sociedad para reaccionar ante cambios internos y externos y hacer frente a sus mecanismos de regulación es un tema fascinante. Obviamente, es un gran campo para los sociólogos, etnólogos, economistas, psicólogos sociales, criminólogos, antropólogos, etcétera. Más recientemente, los físicos y matemáticos están empleando sus modelos y su experiencia para conseguir una mejor comprensión de la conducta colectiva de los sistemas sociales.

Por ejemplo, la convergencia (o divergencia) de ideas u opiniones entre los participantes de un debate es un proceso social muy importante. En algunos modelos de la dinámica de opinión que han sido revisados por Weidlich, Lorenz, y Castellano y colaboradores, los agentes pueden negociar sus diferencias para tratar de llegar a un consenso.

En la práctica, es plausible asumir que los debates tienen lugar cuando las opiniones de las personas implicadas (agentes) están lo suficientemente cerca uno del otro para poder negociar sus diferencias y tratar de llegar a un consenso. En este sentido, un modelo importante y simple de dinámica de opiniones es el desarrollado por el modelo de Deffuant y colaboradores.

Supongamos que tenemos una red definida como un conjunto de nodos y enlaces fijos (en el modelo original se propuso una simple dinámica de opinión para la gráfica o red completa, donde todos los nodos están conectados entre ellos, pero aquí lo presentamos para cualquier gráfica o red). En cualquier asunto, la opinión correspondiente es representada por un número continuo Θ entre 0 y 1. Se selecciona cualquier agente i y luego con la misma probabilidad para todos sus vecinos, se selecciona uno de ellos, llamado j. En la práctica es plausible asumir que los debates tienen lugar cuando las opiniones de las personas implicadas (o agentes) son lo suficientemente parecidas o cercanas unas de otras. Si entre vecinos la diferencia de las opiniones Θ i (t) y Θ j (t) supera un determinado umbral, entonces no pasa nada (en este caso t es un tiempo discreto que etiqueta y ordena los pasos de tiempo del proceso iterativo); pero si:

| Θ i (t) – Θ j (t) | < ε,

entonces: Θi (t + 1) = Θi (t) + µ [Θj (t) − Θi (t)] (1),

Θj (t + 1) = Θj (t) + µ [Θi (t) − Θj (t)],

lo cual significa que sus opiniones se acercan, moduladas por el parámetro µ.

Este procedimiento se repite hasta que se alcanza la convergencia. Es habitual utilizar el mismo parámetro de aproximación µ para todos los agentes. Es evidente que la topología subyacente al sistema define a los vecinos de cada agente. La convergencia se alcanza después de emplear el procedimiento de la ecuación (1) iterativamente, y se define un grupo o cúmulo como el conjunto de nodos en la red o agentes que comparten la misma opinión final.

Un ejemplo

Vamos a considerar tres nodos alineados como se muestra en la siguiente figura:

y mostrar como su opinión converge para e = 1 y µ = ½.

Supongamos que en un principio la cantidad de información u opinión en cada nodo es a0, b0, y c0. Puesto que e = 1, entonces sus valores siempre se aproximan en pares siguiendo la ecuación (1) para cualquier valor de la cantidad de información. Si µ= ½, entonces ambas opiniones llegan a ser iguales en el punto medio en un solo paso y el consenso de los dos agentes implicados es total. Es decir, la convergencia entre los dos agentes se produce inmediatamente;

Θ i (t + 1) = Θ j (t) = [Θ i (t) + Θ j (t + 1)] / 2.

Sin perder la perspectiva general, se puede comenzar la simulación, eligiendo un primer nodo a y su nodo más cercano b vecino, por lo que la nueva cantidad de información en cada nodo es:

a1 = a 0 / 2 + b 0 / 2,

b 1 = a 0 / 2 + b 0 / 2,

c 1 = c 0.

En el siguiente paso de simulación, el nodo c y su vecino b son elegidos, así tenemos:

a 2 = a 1 = a 0 / 2 + b 0 / 2,

b 2 = b 1 / 2 + c1 /2 = a0 / 4 + b 0 / 4 + c 0 / 2,

c 2 = b 1 / 2 + c 1 / 2 = a 0 / 4 + b 0 / 4 + c 0 / 2.

Después de n pasos, tenemos:

a n = {a 0 + b 0 + c 0 } /3 + A {a 0 + b 0 − 2c 0 } / (3[ 2 2n ]),

b n = {a 0 + b 0 + c 0 } /3 + B {a 0 + b 0 − 2c 0 } / (3[2 2n ]),

c n = {a 0 + b 0 + c 0 } /3 + C {a 0 + b 0 − 2c 0 } / (3[2 2n ]),

donde a, b y c son constantes.

A partir de estas expresiones uno puede ver que todos los nodos convergen en el mismo punto.

Discusión

Este proceso continuo parece ser un modelo más realista para los dispositivos numéricos (en los que la precisión es fundamental) que para los seres humanos. Un valor preciso de la opinión de un agente humano en un rango infinito (números reales entre 0 y 1) es conveniente para los propósitos numéricos, pero no es realista. Por lo tanto, podemos referirnos al valor numérico de la opinión de un agente determinado como la “cantidad de información” que este agente tiene. De esta manera, podemos pensar en un agente como una persona o cualquier otro dispositivo artificial.

Hemos demostrado cómo una serie numérica surge cuando se trata de sólo tres agentes en la modelo de Deffuant. Un caso más general consiste en escoger dos diferentes valores de µ en una interacción de pares o valores aleatorios. En la práctica vemos que incluso para un pequeño número de nodos, N = 3, y hasta para el caso de las aproximaciones más rápidas (µ = ½), llegar a un consenso perfecto generalmente toma un número infinito de pasos. Para efectos prácticos, en el modelo de Deffuant aplicado a cualquier sistema con cualquier valor de agentes, la serie convergente resultante se puede truncar en cualquier grado deseado de precisión. Para los sistemas sociales es más adecuado un conjunto de valores posibles discreto, no continuo, y además es más fácil de manejar. Aunque este modelo es matemáticamente elegante, no parece ser un modelo realista de las opiniones humanas, porque se necesita un número infinito de pasos para converger o llegar a un consenso. En primer lugar, ¡las vidas humanas son finitas! En segundo, un valor de la opinión de un agente humano ubicado en un rango infinito (números reales entre 0 y 1) no es realista.

En resumen, son más adecuados los modelos de opinión con un número finito de estados para describir o simular el comportamiento social. En los cálculos numéricos, el proceso de convergencia toma mucho tiempo cuando el rango es infinito, salvo en el caso de emplear un pequeño número de dígitos significativos (el redondeo de errores).

Existe otro modelo de opiniones propuesto por Hegselmann y U. Krause, que es similar al de Deffuant, pero en él un agente cambia de opinión por la opinión general de sus vecinos. Es decir, en este modelo un agente, en lugar de interactuar con uno solo de sus vecinos a la vez, como en ocurre en el anterior, va a interactuar a la vez con el promedio de todos los agentes dentro de una región de opiniones similares definida o limitada también por e. Este modelo es más adecuado para describir la formación de opinión cuando la gente se reúne al mismo tiempo en grupos pequeños, donde existe una interacción eficaz con participación de muchas personas al mismo tiempo. Por otra parte, ya que este modelo incluye más agentes al mismo tiempo (como en un verdadero proceso de reuniones), una mayor precisión numérica (como en un proceso de votación) parece naturalmente ser más apropiada que en el modelo anterior.

Los debates en torno a la evolución y convergencia de la computación social se pueden encontrar en la red. Baste concluir aquí mencionando que un modelo como el de Hegselmann y Krause es más realista para los pequeños grupos y se puede aplicar para describir el proceso real de reuniones tanto entre personas físicamente como, dados los tiempos actuales, en la red.

|

|||||||||||

|

Referencias bibliográficas

Weidlich, W. Sociodynamics. 2000. Harwood Academic Publishers, Amsterdam.

Lorenz, J. 2007. “Continuous Opinion Dynamics under Bounded Confidence: A Survey”, en International Journal of Modern Physics C, vol.18, núm. 12, pp. 18191838 (arXiv:0707.1762v2).

Castellano C., S. Fortunato y V. Loreto. 2009. “Statistical physics of social dynamics”, en Rev. Mod. Phys., núm. 81, pp. 591646.

Deffuant, G., F. Amblard, G. Weisbuch y T. Faure. 2002. “How can extremism prevail? A study based on the relative agreement interaction model”, en Journal of Artificial Societies and Social Simulation, vol. 5, núm. 4 (http://jasss.soc.surrey.ac.uk/5/4/1.html).

Hegselmann, R. y U. Krause. 2002. “Opinion dynamics and bounded confidence: models, analysis and simulation”, en Journal of Artificial Societies and Social Simulation, vol. 5, núm. 3 (http://jasss.soc.surrey.ac.uk/5/3/2.html).

|

|||||||||||

| _________________________________________________________ | |||||||||||

|

Yérali Gandica

Centro de Física,

Instituto Venezolano de Investigaciones Científicas. Sergio Rojas

Departamento de Física,

Universidad Simón Bolivar.

Marcelo del Castillo Mussot y Gerardo J. Vázquez

Instituto de Física,

Universidad Nacional Autónoma de México.

como citar este artículo → Gandica, Yérali y et.al. 2011. Modelos de convergencia de opiniones. Ciencias 102, abril-junio, 46-49. [En línea] |

|||||||||||

|

|

PDF →

|

|||||||||

|

||||||||||

|

Huiricuta:

paisaje sagrado

amenazado

Humberto Fernández Borja

|

||||||||||

|

Huiricuta es un paisaje de singular relevancia planetaria por la

conjunción de sus valores culturales y naturales. El Desierto Chihuahuense, ecorregión en la que se encuentra, es una de las tres áreas semidesérticas biológicamente más ricas del planeta. Desde épocas remotas, Huiricuta ha sido el nombre en huichol de la región adyacente al poblado histórico de Real de Catorce al norte de San Luis Potosí. Los huicholes lo consideran como un inmenso “templo natural” que a su vez cobija distintos sitios sagrados naturales.

Este paisaje está expuesto a un amplio espectro de factores de deterioro, desde el sobrepastoreo de ganado caprino o la fragmentación de sus matorrales xerófilos por cultivos intensivos de jitomate, hasta el tráfico de peyote y otras cactáceas o bien la profanación de los sitios sagrados huicholes por parte de turistas y ‘neochamanes’ urbanos. Sin embargo, los planes de explotación minera intensiva en la zona, anunciados en el verano de 2010 por la empresa canadiense First Majestic, suponen una amenaza sustancial a la integridad y al frágil equilibrio de Huiricuta.

Patrimonio biocultural

Huiricuta, situado en el Altiplano PotosinoZacatecano, constituye un territorio altamente representativo de los ecosistemas que abarca el Desierto Chihuahuense. Aunque cubre el 0.30% de su superficie, alberga alrededor de la mitad de su flora, el 60% de sus mamíferos y casi el 80% de su avifauna, con una considerable tasa de endemicidad. De este último grupo, sobresale el águila real, símbolo vivo de México, y que encabeza la lista del programa nacional de conservación de especies prioritarias. Dos aspectos le confieren mayor relevancia: se encuentra en la porción sureste de dicha ecorregión, donde se presenta la máxima concurrencia de cactáceas endémicas o amenazadas; por otra parte, las relaciones biogeográficas de la Sierra de Catorce con la Sierra Madre Oriental le permiten albergar hábitats y especies de notable singularidad para la ecorregión.

En este sentido cabe añadir que la porción norte de Huiricuta está incluida en la Región terrestre prioritaria de la conabio núm. 80 (Tokio) y que la Sierra de Catorce es una de las Áreas de Importancia para la Conservación de Aves en México (aica núm. 81).

Existen elementos de patrimonio cultural de gran diversidad. Para los huicholes, es uno de los paisajes sagrados de mayor jerarquía y fundamental en su cosmogonía. El devenir histórico de los huicholes está íntimamente ligado a las prácticas rituales que llevan a cabo en Huiricuta, como culminación de sus peregrinaciones a través de rutas ancestrales desde sus asentamientos regulares al norte de Jalisco en la Sierra Madre Occidental. Estas rutas son el residuo vigente más representativo del gran enjambre de rutas de intercambio prehispánicas que durante milenios enriquecieron a las culturas del continente americano.

Asimismo, su riqueza contempla importantes vestigios paleontológicos y arqueológicos, incluyendo la huella humana más antigua registrada en México: ca. 31 000 años. Si bien la febril actividad minera de los siglos xviii y xix transformó radicalmente el paisaje y provocó la exterminación de las tribus guachichiles, también dejó como huella una concentración importante de edificaciones, haciendas, empedrados y acueductos. Es en el “Real de Minas de la Purísima Concepción de los Álamos de los Catorce”, donde este patrimonio urbanoarquitectónico es aún más notable. Adicionalmente, la vía de ferrocarril que atraviesa a Huiricuta dio lugar a algunos de los elementos de patrimonio industrial que afortunadamente empiezan a ser revalorados.

Una reserva amenazada

Reserva natural y cultural de Huiricuta es el nombre de divulgación para el área natural protegida que promovimos mediante un primer decreto en 1994 y que posteriormente fue sustituido para ampliar la cobertura territorial, los objetos de conservación y los fundamentos de defensa de los derechos indígenas de los huicholes. Su estatus legal vigente, como Reserva Estatal, es el que se señala en el Periódico Oficial del Gobierno del Estado de San Luis Potosí del 9 de junio de 2001 con una superficie de 140 212 hectáreas y una longitud de la ruta de 139 kilómetros hasta el límite con el estado de Zacatecas, en los municipios de Catorce, Villa de la Paz, Matehuala, Villa de Guadalupe, Charcas y Villa de Ramos.

Como parte de una estrategia de conservación más amplia también logramos que en 2004 la Ruta Tradicional de los Huicholes a Huiricuta se inscribiera en la Lista Indicativa mexicana de la Convención del Patrimonio Mundial Cultural y Natural de la unesco.

Actualmente la empresa canadiense First Majestic Silver Corporation ha emprendido su proyecto minero “Real de Catorce” para la explotación de plata y otros metales. Para ello adquirió el control accionario de dos empresas mexicanas, Minera Real Bonanza, S.A. de C.V. y Minera Real de Catorce, S.A. de C.V., poseedoras de 22 concesiones mineras; el 60% de ellas se encuentran dentro de la Reserva de Huiricuta.

Aún no es claro si será un proyecto de “minería a cielo abierto”, ya que el proyecto no se ha presentado formalmente para obtener las autorizaciones en materia de impacto ambiental o del patrimonio cultural, entre otras. No obstante, la explotación anunciada señala que se llevará a cabo mediante procesos químicos de beneficio en los minerales, con uso intensivo de cianuro, así como de un método de flotación en el que se usan otros químicos altamente contaminantes, como los Xantatos. Tan solo esto tendría un impacto irremediable a los acuíferos que abastecen a las comunidades aledañas a Real de Catorce, donde se utilizarán cerca de 10 000 litros de agua por cada tonelada extraída de acuerdo a los estándares de uso de agua de una actividad minera similar.

Ante la gravedad de esta amenaza, todas las comunidades huicholas, así como organizaciones civiles y académicas, dentro y fuera de México, solicitamos la intervención urgente de las autoridades competentes y de la sociedad en su conjunto, para evitar un conflicto social y una catástrofe ambiental, así como la violación a la legislación mexicana y diversos tratados internacionales, y preservar así este patrimonio de gran valor para el país y fundamental en la vida del pueblo huichol.

|

||||||||||

|

_____________________________________________________________

|

||||||||||

|

Humberto Fernández Borja

Conservación Humana, A.C.

como citar este artículo → Fernández Borja, Humberto. (2011). Huiricuta: paisaje sagrado amenazado. Ciencias 102, abril-junio, 38-39. [En línea] |

||||||||||

|

|

PDF →

|

|||||||||

|

||||||||||

|

Patricia Magaña Rueda

|

||||||||||

|

Lo primero que viene a la mente al hablar de basura es una serie

de olores y texturas indeseables, de las que no quisiéramos volver a saber. El término basura es muy general, ya que engloba todos los elementos que son mezclados y desechados porque se les considera no útiles. Hablando de la basura que se genera en casa, lo que hacemos es entregarla a los encargados de “deshacerse” del problema y olvidarnos de él. Pero sabemos poco sobre la forma en que se transporta, separa, trata y hasta se utiliza, y a la mayoría le preocupa todavía menos lo que representa en contaminación y daño al medio, excepto cuando nos lo recuerdan los lineamientos y reglamentos ordenados por la autoridad.

En el Distrito Federal, donde se llega a hablar de la producción de hasta quince mil toneladas diarias, el problema es creciente, y durante décadas los gobiernos locales no han desarrollado un proyecto claro para contender con el mismo. Desde 2003 la Asamblea aprobó la Ley de residuos sólidos (nótese que es un término distinto a basura). Su aplicación se ha ido posponiendo por muchos factores, particularmente la falta de infraestructura. Cinco años después, en diciembre de 2008, se publicó el reglamento correspondiente a la Ley, y apenas este 2011 se ha puesto realmente en marcha, con las correspondientes sanciones, involucrando en primera instancia a los ciudadanos.

La preocupación del Gobierno del D. F. responde, sobre todo, al cierre del Bordo poniente, una enorme área ubicada entre el Distrito Federal y el Estado de México, donde se depositaban las docenas de toneladas diarias que produce la gran urbe. Y aunque ha causado un fuerte debate, y ha habido propuestas para aprovechar el gas metano que genera este inmenso tiradero, todavía no está claro qué va a pasar con toda la basura una vez cerrado este depósito, como lo acreditan diversas notas periodísticas (www.oem.com.mx/elsoldemexico/notas/n1992482.htm).

La responsabilidad es gubernamental, pero sin la participación ciudadana el asunto difícilmente encontrará vías adecuadas de solución a corto o largo plazo. Y aunque la información juega un papel central en la búsqueda de alternativas, ¿han servido los años transcurridos entre la aprobación de la Ley y su puesta en marcha para instruir y verdaderamente preparar a la población para entender el problema de la “basura”? La respuesta, desgraciadamente, es no. Y esto tendrá un papel central en los planes que sigan los distintos gobiernos en el futuro.

La Ley de residuos sólidos hace referencia en sus artículos 10, 11, 16, 17 y 18 a la necesidad de difundir su contenido y orientar a la población en sus detalles, pero más aún en el sustento para aplicarla. En los hechos, más allá de un cartel y algunos folletos, poco se hace. Si usted está interesado en conocer la Ley, visite la Gaceta Oficial del Distrito Federal (www.sma.df.gob.mx), un portal que además de permitirle descargar el documento completo, en su menú principal incluye el apartado “residuos sólidos” que contiene el nuevo programa de 2011 que lleva el nombre de “Juntos pero no revueltos”, datos, material de difusión, planes de manejo y hasta un apartado de denuncias por incumplimiento.

Pero, ¿por qué separar la basura y cómo hacerlo? La respuesta más simple sería que separar basura orgánica e inorgánica permitirá reciclar y no contaminar tanto. Pero más bien habría que hacerse dos preguntas más profundas: ¿se puede hacer algo para producir menos basura?, ¿están informados y concientes los ciudadanos del problema que representan los residuos sólidos, la forma de disponer de los mismos y lo que significa cambiar nuestros hábitos? Las respuestas ya no son tan simples y requieren programas más cuidadosos con un mayor número de personas involucradas —y no sólo los habitantes de la ciudad—, pues tendría que incluirse al personal de limpia, los industriales que producen cualquier tipo de elemento consumido, los fabricantes de empaques, los involucrados en el reciclaje y, por supuesto, los interesados en desarrollar ciencia y tecnología para contender con el problema.

En un primer intento, el gobierno local, por medio de su portal, presenta un programa más amplio que el solo reglamento y se llama “Plan verde. Ciudad de México”. En él se enmarca el manejo de residuos sólidos que incluye no sólo la separación de la basura, sino también el reciclaje y la reutilización de elementos (www.planverde.df.gob.mx/).

Lo adecuado sería entonces hacer una campaña que no se centre en conocer qué es orgánico y qué es inorgánico, lo cual indudablemente es importante, sino cómo nos hacemos de productos que generen menos residuos, cómo tener vías para ubicar lo reutilizable o lo que es reciclable y, finalmente, cómo disponer de manera adecuada de lo que hay que desechar, incluidas muchas sustancias y materiales que usamos en casa o en la oficina, que se siguen eliminando sin regulación y contribuyen a una alta contaminación de suelos, agua y mares.

Algunos pequeños libros o folletos sobre el tema de la basura han sido trabajados con cuidado y claridad. Uno de ellos fue elaborado, en 2004, por Raúl Herrera Massieu. En él, además de datos básicos y definiciones claras, se plantea cuestionamientos que pueden servir de base para apoyar la difusión de la Ley de residuos sólidos. Conviene consultar este texto que incluye una sección de preguntas frecuentes muy esclarecedoras (www.sma.df.gob.mx/educacionambiental/pdf/como.pdf).

Hay países que son exitosos en el manejo de sus residuos, tal es el caso de Alemania, donde se educa en términos de generar menos basura; muchas familias producen composta con los desechos orgánicos, y el reciclamiento está regulado por leyes, de manera que los empaques y recipientes en que se venden los productos vuelvan a ser responsabilidad de los fabricantes y por lo tanto les deben ser regresados para su disposición. Esto fue introducido desde 1991 por medio del llamado Dual System Germany Ltd., al cual se ha unido una gran cantidad de países en Europa. Su propósito fundamental es asegurar la recuperación y reciclamiento de los empaques en la forma más eficiente y amigable con el ambiente. Se puede aprender mucho de ellos (www.proe.org/Introduction.html).

En resumen, hay necesidad de desarrollar ciencia y tecnología sobre mejores y más amigables materiales, así como procesos de reutilización y manejo de muchas sustancias. De igual manera, la población tendrá que proponer se incentive la parte industrial de utilización y reciclamiento como una tarea importante en el país. Pero debería de haber un objetivo fundamental de difusión, que es también educativo: lograr, como en otras muchas cosas, un cambio de actitudes en nosotros, lo cual nunca es sencillo.

|

||||||||||

|

_____________________________________________________________

|

||||||||||

|

Patricia Magaña Rueda

Facultad de Ciencias,

Universidad Nacional Autónoma de México.

como citar este artículo → Magaña Rueda, Patricia. (2011). ¿Es sólo basura? Ciencias 102, abril-junio, 24-26. [En línea] |

||||||||||

|

|

PDF →

|

|||||||||

|

||||||||||

|

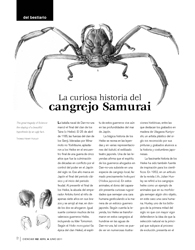

La curiosa historia

del cangrejo samurai

Héctor T. Arita

|

||||||||||

|

The great tragedy of Science

the slaying of a beautiful hypothesis by an ugly fact. Thomas Henry Huxley

La batalla naval de Dannoura marcó el final del clan de los Taira

(o Heike). El 25 de abril de 1185, las fuerzas del clan de los Genji, lideradas por Minamoto no Yoshitsune, aplastaron a los Heike en el encuentro final de una guerra de cinco años que fue la culminación de décadas en conflicto por el control del poder en el Japón del siglo xii. Ese año marca en Japón el final del periodo clásico y el inicio del periodo feudal. Al presentir el final de los Heike, la abuela del emperador Antoku tomó al niño de apenas siete años en sus brazos y se arrojó al mar, en donde los dos se ahogaron. Igual suerte corrieron muchos de los valerosos guerreros Heike, incluyendo su líder Tomomori. Según el Heike monogatari (la épica del clan Heike), el espíritu de estos guerreros vive aún en las profundidades del mar de Japón.

La trágica historia de los Heike se recrea en las leyendas y en varias representaciones del kabuki, el estilizado teatro japonés. Una de las leyendas afirma que el espíritu de los guerreros ahogados en Dannoura subsiste en una especie de cangrejo local, llamado precisamente heikeganiHeikea japonica). En estos animales, el dorso del caparazón presenta curiosas rugosidades que semejan una cara humana gesticulando a la manera de un estoico guerrero japonés. Según cuenta la leyenda, los Heike se transformaron en estos cangrejos al hundirse en las aguas de Dannoura, tal como se puede ver en numerosas ilustraciones históricas, entre las que destacan los grabados en madera de Utagawa Kuniyoshi, un artista plástico del siglo xix reconocido por sus pinturas y grabados alusivos a la historia y costumbres japonesas.

La fascinante historia de los Heike ha sido también fuente de inspiración para los científicos. En 1952, en un artículo de la revista Life, Julian Huxley se refirió a los cangrejos heike como un ejemplo de animales que en su morfología semejan algún otro objeto, en este caso una cara humana. Huxley, uno de los biólogos de la primera mitad del siglo xx que con mayor vigor defendieron la idea de que la selección natural es la principal que subyace al proceso de evolución, presenta en el artículo varios casos de animales imitadores (copy cats) que al aparentar ser otro objeto obtienen beneficios para su supervivencia o reproducción. En particular, insiste en que el peculiar aspecto de los heikegani no puede deberse a la mera casualidad, y que más bien es “una adaptación específica que sólo pudo haber sido producida por la selección natural actuando a lo largo de cientos de años”. Según Huxley, los pescadores del mar de Japón, por respeto a los guerreros Heike, han evitado por generaciones comer aquellos cangrejos con mayor semejanza a una cara humana, de manera que a lo largo de las generaciones estos animales han sido favorecidos por la selección (en este caso artificial) y son hoy en día más frecuentes que los cangrejos con menor parecido a una cara.

La hipótesis de Huxley fue retomada años más tarde por Carl Sagan en el episodio “Una voz en la fuga cósmica”, de su serie de televisión Cosmos, para ilustrar, con la inigualable elocuencia que caracterizaba al célebre astrónomo y divulgador, el concepto de la selección artificial. “¿Cómo se consigue que el rostro de un guerrero quede grabado en el caparazón de un cangrejo?”, se pregunta en forma retórica Sagan. “La respuesta parece ser que fueron los hombres quienes hicieron la cara”. La explicación de Sagan es básicamente la misma que la de Huxley: en un pasado remoto pudieron haber surgido algunos cangrejos con una ligera semejanza a una cara humana. Los pescadores, al observar el parecido y en remembranza de los guerreros ancestrales, habrían regresado estos cangrejos al mar, permitiendo su supervivencia y reproducción. Los cangrejos ordinarios sin rasgos faciales dibujados en sus caparazones, por el contrario, habrían terminado sus días en la mesa de los pescadores. Después de cientos de años, debido a este proceso de selección dirigida por los pescadores, los cangrejos más parecidos a una cara se habrían hecho cada vez más numerosos hasta convertirse en la forma más común en la población. Un bello ejemplo de selección artificial. ¿O no?

La realidad es que es muy poco probable que la morfología del caparazón de los heikegani tenga algo que ver con los pescadores japoneses, y mucho menos con los guerreros samuráis del siglo xii. La cara en los caparazones es un ejemplo de pareidolia, el fenómeno psicológico por medio del cual la mente tiende a formar imágenes reconocibles a partir de un estímulo vago y aleatorio. Es por la pareidolia (del griego eidolon, figura o imagen) que creemos reconocer figuras en la configuración de las nubes o vemos siluetas de animales, personas o demonios en las manchas de tinta de la prueba de Rorschach. Por el mismo proceso la gente crédula afirma reconocer figuras como caras o pirámides en la disposición de los accidentes geológicos de Marte o imágenes de la virgen María en pedazos de roca, troncos de árbol o hasta en los patrones que aparecen en los panes tostados.

Las rugosidades que vemos en el caparazón de los cangrejos resultan de la disposición de los sitios en que se insertan los músculos. La simetría bilateral de los cangrejos y la particular localización de las rugosidades hacen que los caparazones, a primera vista, realmente parezcan rostros. Incluso la mayoría de la gente afirmaría reconocer gestos en esas caras. La realidad, sin embargo, es que estamos frente a un típico caso de pareidolia en la que unos cuantos trazos (la posición de las inserciones musculares) permiten a nuestro cerebro completar lo que interpretamos como un patrón conocido, en este caso una cara. Por supuesto, ningún científico serio piensa que esos rostros realmente son los de los guerreros Heike caídos en la batalla de Dannoura.

Aun si las supuestas caras en los caparazones son una pareidolia, la hipótesis HuxleySagan podría ser correcta si en efecto los pescadores ejercen de alguna manera una presión selectiva sobre las poblaciones de los cangrejos. En 1993, Joel Martin publicó en la revista Terra un análisis del curioso caso de los cangrejos samuráis y, no sin cierto dejo de tristeza, presentó varias piezas de evidencia en su contra. Para empezar, hay que recordar que, como señala Martin, existen muchas especies de cangrejos, además de los heikegani, en las que se pueden observar figuras semejantes a rostros humanos. Si la hipótesis de Huxley es correcta, entonces tendríamos que pensar que en todos los lugares en los que existen cangrejos con caparazones semejantes a caras habría gente que selectivamente los protege. El problema es que existen también fósiles de cangrejos emparentados con los heikegani en los que aparecen los supuestos rostros. Estos fósiles provienen por supuesto de tiempos anteriores a la batalla de Dannoura, son más antiguos que el propio ser humano. Claramente, la selección artificial no puede explicar la existencia de esos fósiles.

Más devastador para la hipótesis de la selección artificial es el hecho de que la fuerza de selección propuesta por Huxley no existe. Los pescadores japoneses ni siquiera se comen los cangrejos samuráis, independientemente de si tienen o no “caras” en el caparazón. De hecho, los heikegani son tan pequeños (miden apenas unos tres centímetros) que realmente no vale la pena siquiera intentar extraer algo de carne de ellos. Los pescadores suelen devolver estos cangrejos al mar, no por respeto a los guerreros ancestrales, sino simplemente porque los crustáceos no les son apetecibles.

En suma, dadas todas estas evidencias, la explicación de Huxley y Sagan, por bella que parezca, no se sostiene ante los hechos científicos. La historia de los heikegani es un ejemplo de lo que T. H. Huxley, el abuelo de Julian, llamó “la gran tragedia de la ciencia: la muerte de una bella hipótesis en manos de una fea verdad”.

Nota

Una versión anterior de este ensayo apareció en el blog “Mitología Natural” (www.hectorarita.wordpress.com) el 14 de noviembre de 2010.

|

||||||||||

|

Referencias bibliográficas

Huxley, J. S. 1952. “Evolution’s copycats”, en Life, 30 de junio de 1952.

Martin, J. W. 1993. “The Samurai Crab”, en Terra, vol. 31, núm. 4, pp. 3034.

Sagan, C. 1982. Cosmos. Editorial Planeta, Barcelona.

_____________________________________________________________ |

||||||||||

|

Héctor T. Arita

Centro de Investigaciones en Ecosistemas,

Universidad Nacional Autónoma de México.

como citar este artículo → Arita, Héctor T. (2011). La curiosa historia del cangrejo Samurai. Ciencias 102, abril-junio, 12-15. [En línea] |

||||||||||

|

|||||||||||||||||||||||||||||||||||||||||||||||||

|

Una invitación a la teoría matemática de la música.

II. Armonía y contrapunto

|

|||||||||||||||||||||||||||||||||||||||||||||||||

| Octavio A. Agustín y Emilio Lluis Puebla | |||||||||||||||||||||||||||||||||||||||||||||||||

|

En el primer libro de su tratado De Musica, San Agustín de

Hipona dice que la música es “la ciencia de la buena modulación”. Y no cabe duda que esto es fundamental para la teoría de la modulación tonal, un aspecto de la armonía occidental, donde se pasa de una tonalidad de origen s a una tonalidad destino t en un “buen modo”.

Por supuesto, la sencilla definición de “modulación” como un agradable tránsito de una tonalidad a otra no es muy precisa y ejemplifica el problema del encapsulamiento. Para empezar: ¿qué es una tonalidad? Decir que es “un sistema musical en el que hay relaciones jerárquicas entre los tonos respecto de un centro tonal o tónica” no parece un serio intento por aumentar la precisión del concepto.

Si partimos del hecho de que la materia de la música son los tonos (en particular los de la afinación equitemperada de doce tonos), que una escala es una elección periódica (es decir, que se repite octava tras octava) de estos tonos, y que los acordes son conjuntos de tonos, entonces una tonalidad es un conjunto de acordes elegidos apropiadamente entre los tonos de una escala. A los acordes de una tonalidad también se le llaman “grados”, y generalmente se les numera de acuerdo con su posición en la escala de un tono particular que le pertenece.

Algunos ejemplos pueden ilustrar esto. Cabe recordar que en la notación empleada: c = do, d = re, e = mi, f = fa, g = sol, a = la y b = si; cuando se acompañan del signo # significa que es sostenido (c# = do sostenido).

Ejemplo 1. El conjunto c = {c, d, e, f, g, a, b} repetido en todas las octavas es la llamada escala de c mayor (y se puede escuchar tocando sucesivamente todas las teclas blancas del piano). La tonalidad de c mayor está integrada por los acordes: ic = {c, e, g}, iic = {d, f, a}, iiic = {e, g, b}, ivc = {f, a, c}, vc = {g, b, d}, vic = {a, c, e}, viic = {b, d, f}.

Otro ejemplo sería el conjunto d = {d, e, f#, g, a, b, c#} repetido en las octavas, que es la escala de d mayor. La tonalidad de d mayor está integrada por los acordes: id = {d, f#, a}, iid = {e, g, b}, iiid = {f#, c#, a}, ivd = {g, b, d}, vd = {a, c#, e}, vid = {b, d, f#}, viid = {c#, e, g}.

Según Arnold Schönberg, para iniciar una modulación se utilizan primero algunos acordes que pertenezcan tanto a la tonalidad de salida como a otras (y por eso se denominan “neutros”). Un ejemplo de acorde neutro sería el quinto grado de la tonalidad de c mayor, que es vc = {g, b, d}, que coincide con el cuarto grado de la tonalidad de d mayor ivd = {g, b, d}. A continuación, en una etapa de transición, se usan acordes que funcionan como “pivotes”, anticipando la tonalidad de llegada. Por último, se despliega una “cadencia” para afirmar la tonalidad de llegada: es decir, se presenta una sucesión de acordes que pertenezcan exclusivamente a la tonalidad de llegada. Para formalizar matemáticamente todo lo anterior, primero hemos de identificar los tonos con el anillo Z12, que modela la llamada “aritmética del reloj” (figura 1). Esto es porque en la música se suman y multiplican tonos como se suman o multiplican las horas para transponer escalas o invertir acordes. De este modo, tendríamos que c = 0 (o las 12 en punto), c# = 1, d = 2, d# = 3, e = 4, f = 5, f# = 6, g = 7, g# = 8, a = 9, a# = 10, b = 11.

Ejemplo 2. El acorde que es el primer grado de la tonalidad de c mayor en: ic = {c, e, g} y en números corresponde a ic = {0, 4, 7}. Si transponemos en 2 a este acorde, tenemos: ic + 2 = {0+2, 4+2, 7+2} = {2,6,9} = {d, f#, a} = id, que es el primer grado de la tonalidad de d mayor. Para invertir id, lo multiplicamos por –1 y así –1·id = {–1·2, –1·6, –1·9} = {10, 6 ,3} = {d#, f#, a#}. El lector puede comprobar fácilmente que si transponemos en 2 a toda la escala de c mayor obtenemos la escala de d mayor, esto es, c + 2 = d.

Ahora nos restringiremos a las “escalas mayores”, que son c y todas sus transposiciones. Dada una escala mayor x, definimos una tonalidad x(3)x, iix, …, viix (que son transposiciones de los grados que ya mencionamos en un ejemplo anterior) que recubre toda la escala x, de la que se toman sus tonos. Así obtenemos las doce tonalidades mayores c(3), c#(3), e(3), …, b(3). El conjunto de estas tonalidades lo denotaremos como Dia(3); también se les llama “interpretaciones triádicas de las escalas diatónicas”. como el conjunto de grados i

Si a los acordes de x(3) los representamos como puntos en el espacio tridimensional y conectamos con una línea dos acordes que comparten al menos un tono, luego rellenamos los triángulos que se obtienen si los tres acordes en sus vértices comparten al menos un tono, resultauna superficie triangulada que es una banda de Möbius (figura 2). El orden cíclico de los acordes que surge de recorrer su borde es el llamado “círculo de quintas” (sin tomar en cuenta sostenidos o bemoles). Es interesante notar que Schönberg también descubrió esta construcción y la denominó Harmonisches Band, o “banda armónica”.

Otro aspecto interesante de la banda armónica es que representa objetos musicales (acordes o grados de una tonalidad) y sus relaciones (cómo comparten tonos). Tales relaciones son operaciones lógicas, pues finalmente son intersecciones de conjuntos (que a fin de cuentas están definidas por predicados lógicos). Esto significa que la banda armónica es una representación geométrica de un hecho lógico, idea que se extiende a toda la música por medio de la teoría de topos (que, repetimos, es una amalgama de la lógica y la geometría).

Podemos enseguida definir rigurosamente qué es una cadencia: es un conjunto mínimo de grados de una tonalidad x(3) tales que las triadas que lo conforman no pertenezcan a otra tonalidad. A continuación listamos todas las cadencias posibles: k1 = {iix,vx}, k2 = {iix,iiix}, k3 = {iiix, ivx}, k4 = {ivx, vx}, k5 = {viix}.

Llama la atención la cadencia k4, pues está conformada por los grados que tradicionalmente se denominan “subdominante” y “dominante”, respectivamente. Son un mecanismo clásico para afirmar la tonalidad en la música occidental, omnipresente en la música popular actual.

Disponemos ya de los ingredientes para describir el modelo de modulación propuesto por Mazzola. Parte de la modulación debe ser una función m (o llamada también “simetría”) que transforme la tonalidad de partida s(3) en la tonalidad de llegada t(3), y que llamaremos “modulador”. Pedimos que sea de la forma m(x) = ax + b, donde a = 1, 5, 7, 11 son precisamente los elementos de Z12 que tienen inversos multiplicativos, y que además mande a la escala s de la tonalidad s(3) en la escala t de t(3). Se puede ver que hay exactamente dos funciones de este tipo. Puede ser que o bien t(3) = s(3) + t para algún t; o que t(3) = as·s(3) + t para algún t, donde as es la única inversión que deja la escala s invariante. Se puede comprobar que solamente hay diez funciones que transforman a s(3) en t(3) como se ha descrito.

Ejemplo 3. Ya vimos que c + 2 = d, y evidentemente c(3) + 2 = d(3). Si s es la escala de c mayor, c, entonces ac(x) = 4 – x. En efecto, –{0, 2, 4, 5, 7, 9, 11} + 4 = {0 + 4, –2 + 4, –4 + 4, –5 + 4, –7 + 4, –9 + 4, 11 + 4} = {4, 2, 0, 11, 9, 7, 5}.

El modulador nos dice cómo ir de una tonalidad a otra, pero falta decir cómo debe comportarse respecto de las cadencias de las tonalidades. Es decir, debemos establecer cuáles grados serán los pivotes. Para tal fin, se introduce el concepto de “cuanto de modulación” respecto de la cadencia k y el modulador m, que es un conjunto de tonos m con las siguientes propiedades: a) el modulador debe ser una simetría de m, es decir, m(m) = m; b) los tonos de los grados de la cadencia k de T(3) deben estar contenidos en m; c) el conjunto de los tonos que pertenecen tanto a m como a t debe ser rígido, es decir, no tiene simetrías distintas a la identidad; d) el conjunto m es el que tiene la menor cantidad de elementos, de modo que se cumplan las dos primeras condiciones.

Ejemplo 4. Supongamos que tenemos el modulador m(x) = 11x + 6 que lleva a la tonalidad de c en la tonalidad de d y la cadencia clásica k={iv, v}. Entonces el cuanto de modulación respecto de (m,k) es m = {1, 2, 4, 5, 7, 9, 11}. Efectivamente, m({1, 2, 4, 5, 7, 9, 11}) = 11·{1, 2, 4, 5, 7, 9, 11} + 6 = {5, 4, 2, 1, 11, 9, 7}. Los tonos que pertenecen tanto a m como a d son {1, 2, 4, 7, 9, 11}, y si se opera con todas las simetrías de la forma f(x) = ax + b con a = 1, 5, 7 11 se ve que solamente f(x) = x la deja invariante. También es un cálculo (largo y tedioso, pero sencillo) ver que no hay otro conjunto más pequeño que satisfaga esto.

De lo anterior se desprende el siguiente teorema: para dos tonalidades diferentes, s(3) y t(3), existe un cuanto de modulación m respecto de (m,k). Además, tiene las siguientes propiedades: a) el conjunto m es una unión de los grados de s(3) y t(3); éstos definen a la interpretación triádica m(3) de m; b) los grados comunes de t(3) y m(3) se denominan “grados pivotes de la modulación” (k,m); c) el modulador m está determinado de forma única por los grados de la modulación.

Ejemplo 5. La interpretación triádica del m del ejemplo anterior es viid = {1, 4, 7}, iic = {2, 5, 9}, iiic = iid = {4, 7, 11}, vc = ivd = {7, 11, 2}, vd = {9, 1, 4} y viic = {11, 2, 5}, pues son los grados de c(3) y d(3) cuyos tonos están contenidos en m. Los grados comunes entre d(3) y m(3) son iid, ivd, vd y viid, por lo que éstos son los grados pivotes en la modulación de c(3) a d(3).

Los pivotes predichos por este modelo coinciden con los propuestos por Schönberg en su tratado Harmonielehre. Pero lo importante del enfoque matemático no es su concordancia con las ideas de Schönberg o las de cualquier otro teórico de la música, pues en ese caso resultaría superfluo. Lo fundamental es que descansa en pocos principios bien definidos y que se puede extender a otros ámbitos de manera natural: funciona para las escalas armónicas menores, las escalas de tonos enteros o en todo lo anterior pero en afinaciones justas, pitagóricas o microtonales. Inclusive pueden reemplazarse los tonos por los golpes del metrónomo en un compás de doce octavos (por tomar un metro particular) para efectuar ¡modulaciones rítmicas! Un ejemplo de ellas puede escucharse en la obra Synthesis de Guerino Mazzola.

Contrapunto

El contrapunto, parafraseando a K. Jeppesen, es el arte de preservar, de manera balanceada y armónica, la independencia de las voces en una composición polifónica. Por ello, si en la armonía los protagonistas son los acordes y las modulaciones, en el contrapunto son los intervalos y las consonancias, que son finalmente las relaciones que existen entre las voces de una composición polifónica.

Ahora bien, un “intervalo” es la distancia que existe entre un tono y otro. En ese sentido, hay solamente doce distancias posibles (sin tomar en cuenta octavas) y por eso también podemos modelarlas con Z12. También tienen nombres musicales tradicionales (cuadro 1). En el contrapunto clásico descrito por Johann Fux en su obra clásica Gradus ad Parnassum, las consonancias son el unísono (que engloba a las octavas), la quinta justa y las terceras y sextas (tanto menores como mayores). El resto son disonancias. Si se codifican como los elementos de Z12 vemos que las consonancias son k = {0, 3, 4, 7, 8, 9} y las disonancias son d = {1, 2, 5, 6, 10, 11}, cada conjunto con seis intervalos.

Una observación fundamental de Mazzola es que la transformación p(x) = 5x + 2 transforma consonancias en disonancias y recíprocamente: p(k) = d, p(d) = k. Además, es la única simetría con esta propiedad (y por eso es denominada “polaridad”). Con esto se pone de manifiesto que las simetrías deben incluir ahora multiplicación por quintas y cuartas, además de la inversión que se emplea en la armonía. Sin embargo, estas operaciones no se pueden visualizar tan fácilmente en la aritmética del reloj. Pero cambiando un poco la perspectiva (como aconseja la filosofía de Yoneda), hay una manera de resolver esto usando el llamado “toro de terceras” (figura 3), que resulta de ver cada intervalo como una suma de terceras menores (número 3 en el cuadro 1) y mayores (4). Con este objeto geométrico se puede ver que: a) la inversión (11) corresponde a rotar 180 grados respecto del eje que atraviesa el toro; b) la multiplicación por cuartas (5) es la reflexión respecto de un plano horizontal que corta a la mitad al toro, y la multiplicación por quintas (7) la reflexión respecto de un plano vertical que pasa por la tercera menor; c) transponer en una tercera menor equivale a rotar 90 grados y transponer una tercera mayor en un giro de 120 grados.

El contrapunto de la primera especie es la composición polifónica más simple, donde solamente hay dos voces que emiten notas de idéntica duración y son tales que los intervalos entre ellas siempre son consonancias (figura 4). Al componer contrapunto de la primera especie, generalmente una de las voces está dada de antemano y se le llama cantus firmus, mientras que la otra se construye de acuerdo con ciertas reglas y se denomina discanto. Además, es deseable que el discanto permanezca siempre por debajo, o bien siempre por arriba del cantus firmus. Cuando no sucede así, se dice que las voces se cruzan, por lo que se evita en la medida de lo posible. Por ello, en lo sucesivo supondremos que siempre el cantus firmus está por debajo del discanto y que entonces todos los intervalos entre ambas voces son ascendentes.

Para modelar el contrapunto de la primera especie y formalizar matemáticamente las reglas para componerlo se requiere solamente una voz (el cantus firmus) y asociarle intervalos, pues de esta manera queda determinada unívocamente el discanto. Esto se logra utilizando el anillo de los “números duales” sobre Z12, que es el anillo cociente Z12[e] = Z12[x]/(x2) = {a + eb: a, b pertenecen a Z12}. Cada número dual a + eb representa un intervalo de contrapunto, donde a es el tono del cantus firmus y b el intervalo entre el cantus firmus y el discanto. Por lo tanto, el tono del discanto es a + b. Vale recalcar que los intervalos que se emplean en el contrapunto de la primera especie son: k[e] = {a + ec, a pertenece a Z12 y c es una consonancia}. El resto de los intervalos de contrapunto son los intervalos disonantes d[e] = {a + ec, a pertenece a Z12 y c es una disonancia}.

Es posible multiplicar intervalos de contrapunto de la siguiente manera: (a + xb)(c + xd) = (ac + x)(ad + bc). También pueden sumarse: (a + xb) + (c + xd) = (a+c) + e(b + d).

Tales operaciones algebraicas no son vanos caprichos matemáticos, pues son musicalmente significativas: representan algunas de las transformaciones comunes en el contrapunto doble, permiten reinterpretar los intervalos cuando se cruzan las voces y son un elemento crucial para obtener el modelo matemático del contrapunto clásico de la primera especie. Para entender el por qué de esto último, empezaremos por notar que la multiplicación de intervalos de contrapunto permite definir simetrías de los intervalos de contrapunto, análogas a las de los intervalos sencillos. En este caso, una simetría es de la forma siguiente: f(a + eb) = (u + ey)(a + eb) + (s + et), donde u = 1, 5, 7, 11.

Así como existe una transformación p(x) = 5x + 2 que intercambia los intervalos consonantes por disonantes, para cada cantus firmus a existe una transformación pa(c + ed) = 5(c + ed) + 8a + e2 que intercambia los intervalos de contrapunto consonantes por disonantes, es decir, pa(k[e]) = d[e]. Adicionalmente, deja invariantes los intervalos con cantus firmus a (esto es, pa(a + eb) = a + eb’). La llamaremos una “polaridad relativa” (respecto de a). Por ejemplo, el intervalo de una quinta justa sobre d es 2+e7, y p2 lo manda a p2(2 + e7) = 5(2 + e7) + 8·2 + e2 = (10 + e11) + 4 + e2 = 10+4 + e(11 + 2) = 2 + e1, que es una segunda menor sobre d y es, desde luego, una disonancia.

Una simetría de intervalos de contrapunto f permite “deformar” las consonancias k[e] (figura 5), de modo que los elementos de f(k[e]) son “consonancias deformadas”; algunas siguen siendo consonancias, pero otras no. Supongamos ahora que elegimos algún intervalo consonante a + eb que no es una disonancia deformada por f, es decir, a + eb no pertenece a f(k[e]). Entonces todos los restantes elementos que pertenecen a f(k[e]) y a k[e] son consonancias que “suavizan” la disonancia deformada a + eb. Esto permite introducir una tensión horizontal en el contrapunto, a pesar de que en el contrapunto de la primera especie debemos restringirnos a utilizar consonancias. Efectivamente: a un intervalo de contrapunto que es una consonancia podemos verlo como disonancia deformada, y entonces contraponerle un “sucesor” que sea al mismo tiempo un intervalo de contrapunto consonante y una consonancia deformada.

Naturalmente, nos gustaría que para un intervalo de contrapunto a + eb la simetría f sea tal que dispongamos de la mayor cantidad posible de elecciones para el intervalo de contrapunto sucesor. También es deseable que la polaridad relativa respecto de a intercambie a f(k[e]) y f(d[e]), es decir, que el mismo modo de intercambiar consonancias por disonancias intercambie consonancias y disonancias deformadas. Entonces, dado el intervalo de contrapunto a + eb, diremos que f es una “simetría de contrapunto” para dicho intervalo si se satisface lo siguiente: a) el intervalo a + eb no es una consonancia deformada por f, es decir, a + eb no está en f(k[e]); b) la polaridad relativa pa(x) intercambia consonancias deformadas por disonancias deformadas, esto es, pa(f(k[e])) = f(d[e]); c) el conjunto de consonancias que también son consonancias deformadas por f es el más grande posible, tal que f tiene las dos propiedades anteriores.

Dada una simetría de contrapunto f para un intervalo de contrapunto a + eb, todos los elementos que son tanto consonancias como consonancias deformadas por f son sucesores “admisibles” de a + eb. Tenemos entonces como resultado un teorema de contrapunto: cualquier intervalo de contrapunto consonante a + eb tiene al menos 36 sucesores admisibles. En particular, cada intervalo de contrapunto tiene una simetría de contrapunto. Además, si se elige de antemano el cantus firmus del intervalo sucesor, siempre existe al menos un sucesor admisible para dicho cantus firmus.

Ejemplo 6. Consideremos el intervalo de contrapunto 0 + e7 (la quinta perfecta sobre c) y la simetría g(a + eb) = 7(a + eb). Ésta es una simetría de contrapunto para el intervalo, pues g(k[e]) = Z12 + e{0, 1, 3, 4, 8, 9}, así que 0 + e7 no es una consonancia deformada.

Es fácil verificar que éste satisface el resto de las propiedades, y que el número de sucesores admisibles es de 60, lo cual significa que todos los intervalos consonantes pueden suceder a una quinta perfecta, salvo la quinta justa. Ésta es una regla que también da Fux en su tratado, la gran diferencia es que aquí es una consecuencia del modelo, y no un prerrequisito.

El teorema de contrapunto nos dice que para cualquier cantus firmus podemos componer un discanto exclusivamente con consonancias que son sucesores admisibles. También es interesante que, si restringimos a los tonos del cantus firmus y el discanto para que permanezcan en cierta escala, la escala que nos da la mayor libertad de elecciones para los sucesores es la escala mayor; solamente en dos casos el sucesor admisible es único. Lo contrario pasa con la escala melódica menor: en 16 casos el sucesor es único. Éstas son consecuencias que podrían deducirse de las reglas del contrapunto clásico, pero vale enfatizar que fueron deducidas de unos cuantos principios bien definidos.

En un análisis detallado realizado por Muzzulini y Mazzola, descubrieron que las reglas de Fux restringidas a una octava (el que denominan “estilo estricto restringido”) arrojan un total de 54 progresiones de contrapunto inadmisibles. El modelo matemático da 37 prohibiciones, y coincide con los de Fux en 21 ocasiones. La probabilidad de que alguien, sin saber nada de contrapunto, acierte a dar 21 prohibiciones de las 54 posibles en 37 intentos es ¡menos de 2 en cien millones!

Si bien este argumento favorece el modelo matemático, lo importante otra vez no es atinarle a las ideas de Fux, Palestrina u otros tratadistas o practicantes del contrapunto. Lo importante es la simplicidad, la precisión y la capacidad del modelo para extenderse a otros ámbitos. Por ejemplo, en su tesis de maestría, Jens Hichert demostró que (además de las consonancias y disonancias del contrapunto clásico occidental) existen otras cinco formas de bipartir los intervalos en “consonancias y disonancias”, de modo que el modelo funciona de manera idéntica. Una de esas biparticiones es: i = {2, 4, 5, 7, 9, 11}, j = {0, 1, 3, 6, 8, 10}, esto es, la llamada “dicotomía jonia”. Obsérvese que los elementos de i son los intervalos de cualquier escala mayor tomados a partir de su primer tono.

Usando el modelo del contrapunto con la dicotomía jonia y si restringimos el cantus firmus y el discanto a permanecer en una escala, la escala que nos da la mayor libertad de elección de sucesores admisibles es k* = {0, 3, 4, 7, 8, 9, 11}. Esta escala es casi el conjunto de las consonancias occidentales, y también es casi idéntica a una escala básica para las ragas hindúes: {0, 1, 3, 4, 7, 8, 9}. Resulta así que la música occidental y la hindú son antipodales, en el sentido de que intercambian los papeles de las consonancias y las escalas en sus composiciones, y se pone de manifiesto que la selección histórica del material musical en distintas culturas tiende a optimizar algunos parámetros abstractos.

Para finalizar, cabe mencionar que este modelo de contrapunto se ha verificado parcialmente a nivel neurológico. Los análisis con electroencefalogramas profundos hechos por un equipo liderado por el epilepsiólogo HeinzGregor Wieser y Guerino Mazzola han revelado que el cerebro responde fuertemente a la confrontación de las consonancias y las disonancias que resultan de aplicarle la polaridad. Además, han arrojado algo de luz sobre la interrelación de las emociones y la música: la conclusión es que la música por sí misma no produce emociones, sino que las recupera y las reactiva de entre aquellas presentes en la memoria.

Comentarios finales

Nuestro ejemplo final sobre la fructífera relación entre la matemática y la música pertenece a la teoría enumerativa, que constituye un acercamiento cuantitativo a la clasificación de composiciones locales vía acciones de grupos de permutaciones. El trabajo pionero en el área es de Harald Fripertinger. Esta teoría trata de contar las órbitas de acciones de grupos finitos en conjuntos finitos, los cuales representan objetos particulares especiales, es decir, acordes, particiones de conjuntos de clase de notas o de altura, motivos, sucesiones de 12 notas, etcétera. Los grupos consisten en transformaciones musicales interesantes, tales como la transposición y la inversión.

Un teorema de Fripertinger muestra, en particular, que el número de clases de los motivos de 72 elementos es de: 2 230 741 522 540 743 033 415 296 821 609 381 912 = 2.23…·1036 lo cual indica que no hay escasez de motivos para ser introducidos en la composición musical. Visto de otra manera, a cada estrella de la Vía Láctea podríamos dedicarle una única melodía de más de un millardo de millardos de motivos distintos de 72 tonos.

La música pertenece a los humanos y no aparece ya como una revelación de las divinidades de cualquier índole. Esta renovación se debe también al inmenso arsenal de información y tecnología comunicativa donde la información se convierte en algo muy accesible y la carencia de precisión es de inmediato señalada. Esta situación da lugar a una nueva y fundamental manera de entender el conocimiento humano.

El conocimiento está actualizándose y extendiéndose constantemente, y en él navegamos y experimentamos con un espíritu de espaciotiempo dinámico. Ahora tenemos nuevos paradigmas en musicología. Recordemos el experimento de Galileo acerca de la velocidad instantánea. Su aproximación al problema de la caída libre de los cuerpos fue esencialmente la de la observación y la medición, y no la elaboración de reflexiones abstractas y especulativas. Su punto clave fue el de pasar del encapsulamiento especulativo de Oresme y los científicos medievales a la accesibilidad del “hacer ciencia” con el método operacional: pensar haciendo. Este episodio tiene un análogo musicológico: la velocidad en física con tiempo musical… solamente que 500 años después.

Esto coloca a la física y la musicología en vías paralelas, donde hoy músicos activos y matemáticos, entre otros, están al borde de lo explícito y dejan las especulaciones irrelevantes donde corresponde. Se está abandonando las últimas retóricas vacías. La evolución galileana fue la respuesta a la supuesta profundidad del discurso retórico. Si consideramos los universos creados por el hombre, tales como la matemática y la música, podremos ver que tales universos internos no son menos complicados e incontrolables que la naturaleza externa. Una pieza de naturaleza incontrolable, con su riqueza creativa, con la increíble complejidad nacida de procesos combinatorios, estrategias de interpretación, estratificación semiótica, etcétera, como lo es el Arte de la Fuga de J. S. Bach, no es fundamentalmente diferente de una estrella de neutrones en el espacio interestelar. Estamos viviendo actualmente un cambio tan radical en la musicología como el que se experimentó en la física hace 500 años. ¡Sin duda es un momento maravilloso!

|

|

||||||||||||||||||||||||||||||||||||||||||||||||

|

Referencias bibliográficas

Aceff F. y E. LluisPuebla. 2006. “Matemática en la Matemática, Música, Medicina y Aeronáutica”, en Sociedad Matemática Mexicana. Publicaciones Electrónicas, Serie Divulgación, vol. 1.

_____. 2007. “Matemática en la Matemática II, Música II, Naturaleza y Nuestro Cuerpo”, en Sociedad Matemática Mexicana. Publicaciones Electrónicas, Serie Divulgación, vol. 2.

AgustínAquino, Octavio Alberto. 2009. El Teorema de Contrapunto. Tesis de maestría, unam, México.

_____, J. du Plessis, E. LluisPuebla y M. Montiel. 2009. “Una Introducción a la Teoría de Grupos con Aplicaciones en la Teoría Matemática de la Música”, en Sociedad Matemática Mexicana. Publicaciones Electrónicas, Serie Textos, vol. 10.

Fux, J. J. 1725. Gradus ad Parnassum. Facsímil. Moments of Music and Music Literature, Broude Brothers, Nueva York. 1966.

Hichert, J. 1993. Verallgemeinung des Kontrapunkttheorems für die Hierarchie aller starkenDichotomien in temperierter Stimmung. Tesis de maestría, TU Ilmenau.

Jeppesen, K. 1992. Counterpoint: The Polyphonic Vocal Style of Sixteenth Century. Dover, Nueva York.

LluisPuebla, E. 1990. Álgebra homológica, cohomología de grupos y Kteoría algebraica clásica. Addison Wesley Iberoamericana, México (2a ed.” en Sociedad Matemática Mexicana. Publicaciones Electrónicas, Serie Textos, vol. 5).

Mazzola, Guerino (contribuyentes: E. LluisPuebla et al.). 2002. The Topos of Music. BirkhäuserVerlag, Basilea.

Mazzola, Guerino. 2007. La vérité du beau dans la Musique. Delatourircam, París.

Montiel Hernández, M. 1999. El denotador: su estructura, construcción y papel en la teoría matemática de la música. Tesis de Maestría, unam, México.

Schönberg, A. 1974. Tratado de armonía. Trad. Ramón Barce. Real Musical, Madrid.

|

|||||||||||||||||||||||||||||||||||||||||||||||||

|

____________________________________________________________

|

|||||||||||||||||||||||||||||||||||||||||||||||||

|

Octavio A. Agustín Aquino

Facultad de Ciencias,

Universidad Nacional Autónoma de México.

Estudió la licenciatura en Matemáticas Aplicadas en la Universidad Tecnológica de la Mixteca (Huajuapan de León, Oaxaca) y la Maestría en Ciencias Matemáticas en la Universidad Nacional Autónoma de México. Actualmente es estudiante del Doctorado en Ciencias Matemáticas en la UNAM.

Emilio Lluis Puebla

Facultad de Ciencias,

Universidad Nacional Autónoma de México.

Realizó sus estudios profesionales y de Maestría en Matemática en México. En 1980 obtuvo su Doctorado en Matemática en Canadá. Es catedrático de la Universidad Nacional Autónoma de México desde hace más de treinta años. Ha sido profesor visitante en Canadá.

como citar este artículo →

Agustín Aquino, Octavio A. y Lluis Puebla, Emilio. (2011). Una invitación a la teoría matemática de la música. II. Armonía y contrapunto. Ciencias 102, abril-junio, 68-77. [En línea]

|

|||||||||||||||||||||||||||||||||||||||||||||||||

|

PDF →

|

||||||||

| Percepciones del tiempo y el espacio en las ciencias naturales | |||||||||

| Ramón Peralta y Fabi | |||||||||

|

Pocos temas de ciencia son tratados por los filósofos con la

regularidad con la que se abordan los conceptos de tiempo y espacio. Seguramente tiene que ver con el hecho de que nos son propios a todos. Nadie escapa a su uso cotidiano y si se le pregunta a (casi) cualquiera sobre lo que significan, responderá que sí, desde luego. Pedir que lo ponga por escrito es otro asunto, pues fácilmente se percibe que las definiciones son escurridizas, vagas o circulares. La dirección en la que afinará una idea más precisa dependerá de lo que hace la persona.

Es en el uso cotidiano de espacio y tiempo donde caben nuestras intuiciones sobre cada uno de ellos. El primero, como el escenario o foro en el que están las cosas que son, naturales o abstractas; el “continente”, se dice. En cuanto al tiempo, es el cambio el elemento sustantivo; sin variaciones no hay tiempo o éste no “transcurre”, no fluye. Ciertamente se puede revisar diccionarios o enciclopedias para hallar acepciones que confirmen lo que uno ya entiende o cree saber. El problema será que incluyan cada uno de los aspectos de nuestras experiencias.

Está el punto de vista metafísico. Hay que leer a algunos de los pensadores que han escrito a lo largo de la historia para apreciar las dificultades de ser claro y preciso. Cuando se recurre a la Física de Aristóteles (384-322 a.C.), habiéndose perdido más de 80% de lo que presumiblemente escribió, uno se da cuenta qué tan lejos está de quienes nos interesamos en el tema desde las ciencias naturales; lo único que la física moderna conserva de Aristóteles es la palabra “física”. Algo semejante ocurre si se van revisando distintas construcciones de estos conceptos en lo escrito por otros autores igualmente distinguidos, pasando por el poema de Tito Lucrecio Caro (99-55 a.C.), en el que resume para los latinos la cultura helénica, o más de mil años después por Immanuel Kant (1724-1804), y doscientos más tarde en Martin Heidegger (1889-1976), por citar algunos; a los científicos poco o nada nos aportan.

En las ciencias naturales, como la biología, la química y la física, el tiempo y el espacio son parte esencial, aunque cabe decir, pocas veces son definidos, aclarados o analizados con cuidado. Por otro lado, como parte de la formación científica se hace referencia a las formas de medir uno u otro, y a las muy diversas escalas de ambos, dependiendo de los fenómenos de interés.

Las escalas de tiempo en la biología varían de los miles de millones de años (1016segundos; 102=100, 104=10 000,…), cuando se estudian vestigios primordiales (fósiles) en el contexto del origen de la vida, hasta los diezmilésimos de segundo (10–4s; 10–3=1/1 000, 106=1/1 000 000,…), en los que ocurren procesos celulares o bioquímicos, como el doblamiento de proteínas o la replicación parcial de un ácido ribonucleico. Los “relojes” correspondientes a estas escalas son igualmente diversos.

En cuanto al espacio, se acepta implícitamente la noción clásica del “foro inerte” o absoluto en el que las cosas se dan u ocurren. Pero dentro de éste, hay un espacio que tiene un sentido biocéntrico, en tanto que se percibe como el entorno inmediato que circunda a un ser vivo o a una colectividad de éstos, un nicho ecológico. Este escenario interacciona con los “actores”, modificándose mutuamente; la ecología y las discusiones sobre el cambio climático comparten este fondo. Las escalas espaciales no tienen el intervalo de las temporales y también son biocéntricas: de kilómetros (ecosistemas) a nanómetros (virus, de vida debatible).

En química también se presume un tiempo y un espacio con carácter absoluto. Es decir, los elementos y los compuestos, junto con los procesos que conciernen a la reactividad, esencial en esta disciplina, suceden igual en cualquier momento (invariancia en el tiempo) y la ubicación es irrelevante (invariancia traslacional), en tanto que se cuiden las condiciones de reproducibilidad, como presión, temperatura, etcétera. Las escalas espaciales barren desde las atómicas (10–8m) a las industriales, mientras que las temporales se extienden por muchos órdenes de magnitud: de femtosegundos (10–15s) que duran ciertas reacciones químicas, y se miden con láseres pulsados, hasta las geológicas, típicas de los procesos de formación de rocas y estructuras cristalinas gigantes (1014s).

En física, los conceptos de espacio y tiempo son una parte íntima de la infraestructura, de su entramado más fundamental, y la revisión de éstos, innecesaria en las otras ciencias naturales, ha llevado a transformaciones esenciales.

Desde las primeras teorías de la física, como los trabajos de Galileo Galilei (1564-1642) y de Isaac Newton (1643-1727), el espacio y el tiempo tienen un sentido absoluto. El primero, práctico, los supone evidentes y construye las formas de medirlos, diseñando relojes y patrones de longitud. Así, mejora la clépsidra egipcia, ya asimilada en la cultura latina, que mide tiempos en función del goteo de una vasija bien calibrada, y descubre la isocronía de los péndulos, cuyo periodo de oscilación sólo depende de su longitud y no del material, tamaño de la lenteja que pende o de otras cosas, en tanto que los ángulos iniciales no excedieran 20°. En la obra cumbre de Newton, Principia, se hace la hipótesis implícita de que tanto el tiempo como el espacio tienen este carácter. Gottfried W. Leibniz, en el terreno metafísico e involuntariamente usando a un conocido común, entabla con Newton un debate más sobre tales conceptos. Mientras este último parece imaginarlos como algo absoluto y casi material y tangible, Leibniz introduce un aspecto “relacional”, dándoles más valor en función de los objetos circundantes que por su ubicación o duración. Esta discusión, irrelevante para la física, es tal vez la única hasta los inicios del siglo XX, en que se modificó de fondo el fino entretejido de la física.

Albert Einstein (1879-1955), al revisar los fundamentos de la mecánica de Newton y del electromagnetismo propuesto por James C. Maxwell (1831-1879), y con la información de ciertos experimentos cruciales, formuló la teoría de la relatividad especial en 1905. En ella, el espacio y el tiempo pasan a ser uno, articulados en un espacio nuevo de cuatro dimensiones y con el límite de que ninguna señal o movimiento puede exceder la velocidad de la luz, reconocida desde entonces como una constante universal. En paralelo, se iba erigiendo una nueva teoría del átomo, sus componentes y sus comportamientos; como en la relatividad, las cosas dejaban de ser intuitivamente claras, subsistiendo en ambas teorías el tiempo y el espacio como testigos inertes.